Las empresas de redes sociales preparan su estrategia habitual para combatir las mentiras sobre las elecciones

Los tableros de las elecciones están otra vez en línea, los equipos para verificar información se han vuelto a juntar y las advertencias sobre contenido engañoso abarrotan otra vez los muros de noticias.

Como Estados Unidos marcha hacia otra temporada electoral, las empresas de redes sociales se están preparando para una inundación de desinformación política. Estas empresas, incluidas TikTok y Facebook, están proclamando la implementación de una serie de herramientas y estrategias para las elecciones que parecen similares a sus modelos de años anteriores.

Las organizaciones que vigilan la desinformación advierten que, aunque muchos de estos programas son útiles —en especial los esfuerzos para promover información creíble en varios idiomas—, las tácticas demostraron ser insuficientes en años anteriores y podrían no bastar para combatir la ola de falsedades promovidas esta temporada electoral.

A continuación, los planes de Facebook, TikTok, Twitter y YouTube contra la desinformación.

La estrategia de Facebook para este año en esencia será “coherente con las políticas y salvaguardas” de 2020, escribió la semana pasada en una publicación de blog, Nick Clegg, presidente de asuntos globales de Meta, la empresa matriz de Facebook.

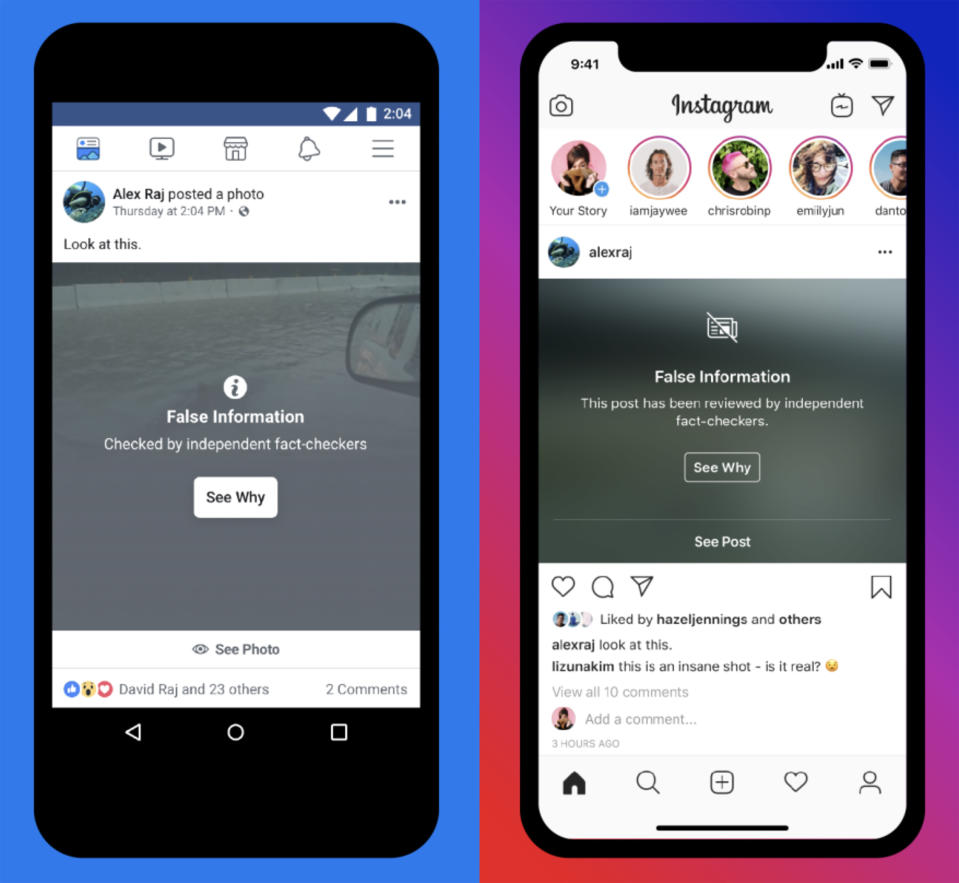

Las publicaciones calificadas como falsas o parcialmente falsas por uno de los diez socios verificadores de información de Facebook en Estados Unidos tendrán una de varias etiquetas de advertencia, lo cual obliga a los usuarios a dar clic sobre un cintillo que dice “información falsa” antes de ver el contenido. En un cambio en comparación con 2020, esas etiquetas serán utilizadas de una “manera más focalizada y estratégica” a publicaciones en las que se debata la integridad de las elecciones intermedias, escribió Clegg, después de que usuarios se quejaron de que se habían “usado demasiado”.

Facebook también ampliará sus esfuerzos para abordar el acoso y las amenazas dirigidas a funcionarios y trabajadores electorales. Según investigadores especializados en desinformación, la empresa se interesó más en moderar el contenido que pudiera producir una violencia en el mundo real después del ataque del 6 de enero de 2021 al Capitolio de Estados Unidos.

Facebook expandió mucho más su equipo electoral después de las elecciones de 2016, a más de 300 personas. Salvaguardar las elecciones se convirtió en un asunto de interés personal para Mark Zuckerberg, el director ejecutivo de Facebook.

Sin embargo, la prioridad de Meta cambió desde las elecciones de 2020. Zuckerberg ahora está más enfocado en crear el metaverso y enfrentar una dura competencia de TikTok. La empresa ha dispersado su equipo electoral y ha señalado que en algún momento después de las elecciones intermedias podría cerrar CrowdTangle, una herramienta que sirve para monitorear desinformación en Facebook.

“Creo que acaban de llegar a la conclusión de que en realidad no es un problema que puedan solucionar en este momento”, opinó Jesse Lehrich, cofundador de Accountable Tech, una organización sin fines de lucro centrada en la tecnología y la democracia.

En un comunicado, un vocero de Meta mencionó que otras partes de la empresa habían absorbido su equipo electoral y que más de 40 equipos estaban enfocados en las elecciones intermedias.

TikTok

En una publicación de blog que anunciaba sus planes para las elecciones intermedias, Eric Han, director de TikTok para la seguridad estadounidense, comentó que la empresa iba a seguir con su programa de verificación de información de 2020, el cual evita que algunos videos sean recomendados hasta que unos verificadores de información independientes comprueben su autenticidad. También presentó un portal de información sobre las elecciones —por ejemplo, para que los votantes sepan cómo registrarse— seis semanas antes de lo que hizo en 2020.

A pesar de esto, hay claras señales de que la desinformación ha prevalecido en la plataforma a lo largo de las primarias.

“TikTok será un portador inmenso de desinformación este ciclo”, opinó Lehrich, quien agregó que los videos cortos y los clips de audio de la plataforma eran más difíciles de moderar, lo cual permite que “inmensas cantidades de desinformación pasen inadvertidas y se propaguen de forma viral”.

Las organizaciones que vigilan la desinformación han criticado a la empresa por una falta de transparencia en torno a los orígenes de sus videos y la eficacia de sus prácticas de moderación. Los expertos han exigido más herramientas para analizar la plataforma y su contenido: el tipo de acceso que brindan otras empresas.

“El consenso es que es muy estresante”, comentó Zeve Sanderson, director ejecutivo fundador del Centro para Redes Sociales y Política de la Universidad de Nueva York. “No sabemos bien qué está pasando ahí”, agregó.

El mes pasado, Vanessa Pappas, directora de operaciones de TikTok, comentó que este año la empresa iba a comenzar a compartir algunos datos con “investigadores seleccionados”.

En una publicación de blog en la que describió sus planes para las elecciones intermedias, Twitter señaló que iba a reactivar su Política de integridad cívica: un conjunto de reglas adoptado en 2018 que la empresa utiliza antes de las elecciones que se realizan en todo el mundo. Conforme la política, se agregarán de nuevo las etiquetas de advertencia, similares a las que usa Facebook, a los tuits falsos o engañosos sobre la votación, las elecciones o la integridad de estas y con frecuencia sugerirá información precisa o contexto adicional a los usuarios. El algoritmo de la empresa no recomienda ni distribuye los tuits que reciben las etiquetas. La empresa también puede eliminar por completo los tuits falsos o engañosos.

Esas etiquetas fueron rediseñadas el año pasado, lo cual dio como resultado un 17 por ciento más de clics en información adicional, mencionó la empresa. Los tuits que usaron las etiquetas modificadas, generaron interacciones, como respuestas y retuits.

La estrategia refleja los intentos de Twitter por limitar el contenido falso sin tener que recurrir siempre a la eliminación de tuits y el veto de usuarios.

YouTube

A diferencia de otras plataformas grandes en línea, YouTube no ha divulgado su plan para 2022 contra la desinformación sobre las elecciones y suele mantener en secreto su estrategia contra la desinformación sobre las mismas.

“Todavía no se sabe nada de YouTube”, comentó Sanderson. “Esto más o menos se alinea con su estrategia general de relaciones públicas, que parece ser: no digas nada y nadie se dará cuenta”.

En una publicación de blog de marzo, Google, la empresa matriz de YouTube, enfatizó los esfuerzos para ocultar contenido autoritario por medio del motor de recomendaciones de la aplicación y para eliminar los videos que engañen a los votantes. En otra publicación dirigida a los creadores, Google detalla la manera en que los canales pueden recibir faltas por compartir ciertos tipos de desinformación y, después de tres faltas en un periodo de 90 días, el canal será eliminado.

En un comunicado, Ivy Choi, una vocera de YouTube, dijo que su equipo electoral se había reunido durante meses a fin de prepararse para las elecciones intermedias y agregó que su motor de recomendación estaba “ocultando de manera continua y preponderante el contenido relacionado con el proceso electoral de fuentes informativas autoritarias, así como limitando la propagación de desinformación perjudicial relacionado con este”.

© 2022 The New York Times Company

Yahoo Finanzas

Yahoo Finanzas