Gabriel Mysler se pregunta: "¿La Inteligencia Artificial nos volverá más humanos?"

La Inteligencia Artificial (IA) generativa es el tema que ocupa el centro de la escena tecnológica y ya ha comenzado a discutirse en el congreso nacional. Gabriel Mysler se especializa en ayudar a crear procesos de innovación en las empresas, una tarea hoy crucial para enfrentar los escenarios de incertidumbre. Y es en los temas de innovación donde la IA aparece con fuerza como un potencial aliado en las tareas laborales.

-¿Cuáles son tus primeras impresiones con la irrupción de las IA generativas?

El ChatGPT parece haberlo revolucionado todo, disparando sensaciones de lo más encontradas. Intelectuales y empresarios firmaron una carta, emitida por el Future of Life Institute, pidiendo pausar el desarrollo avanzado de la inteligencia artificial hasta que expertos independientes desarrollen, implementen y auditen protocolos de seguridad.

Más allá de muchos argumentos atendibles y de los sesgos que se le pueden atribuir a la inteligencia artificial o a las decisiones que ésta pueda tomar, subyace el miedo a los trabajos que pueda destruir y a la gente que podría dejar sin sustento. ¿A qué nos dedicaremos? ¿Como nos ganaremos el "pan"?

Mas allá de la invitación a analizar si es necesariamente malo que el trabajo obligatorio -como maldición bíblica- pudiera llegar a su fin, la carta comparte preguntas inquietantes como: ¿Deberíamos dejar que las máquinas inunden nuestros canales de información con propaganda y falsedad? ¿Deberíamos automatizar todos los trabajos, incluidos los que nos placen? ¿Deberíamos desarrollar mentes no humanas que eventualmente podrían superarnos en número, ser más inteligentes y reemplazarnos? ¿Deberíamos arriesgarnos a perder el control de nuestra civilización? Los líderes de estas tecnologías por ahora presentan mas preguntas que respuestas. Y los gobiernos comienzan a estar muy preocupados.

-¿Considerás que es una revolución tecnológica inédita?

El fuego, los combustibles, las máquinas a vapor, las TIC, la imprenta, la energía nuclear, la decodificación del genoma humano - la ciencia y la técnica concretamente - vienen revolucionado el mundo desde hace milenios. La pólvora y la palanca han sido pilares del desarrollo no menos importantes que las telecomunicaciones y la electricidad. El tema ha sido desde siempre no la potencia de la herramienta sino la intencionalidad de su uso.

El mayor riesgo que entraña la Inteligencia Artificial no es dejar a la gente sin trabajo, sino llevarnos a un mundo eficiente, pero sin sentido ni valores. Mucho se discute sobre los trabajos que reemplazará y destruirá la IA. Mucho se debate sobre el fin del trabajo de oficina. Esta es tan solo la punta del iceberg y –a mi entender– la cuestión más fácil de resolver. Cuando se habla de la IA se pone el acento en los puestos de trabajo que va a reemplazar y en la población vulnerable que puede tener problemas para reconvertir sus trabajos.

Gobiernos y empresas deben prepararse para este cambio que es sin lugar a duda muy fuerte. Pero, así como en las anteriores revoluciones industriales los trabajadores comenzaron a "colaborar" con las máquinas y los sistemas, también lo harán con la IA. Son muchos los trabajos que aparecieron y desaparecieron en los últimos milenios, desde que el hombre dejó de ser cazador / recolector. Muchísimos trabajos ya no existen y muchos nuevos surgen y surgirán: nadie trabaja de farolero hoy, ni trabajaba de Community Manager o Data Scientist hace 50 años.

-En IBM hablan de la ética de los algoritmos frente al problema de la caja negra. ¿Cómo ves ese tema?

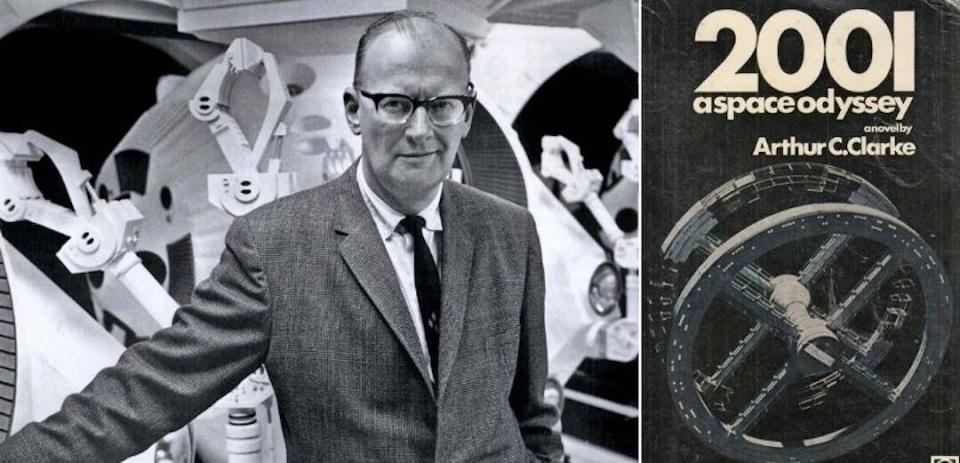

El problema que subyace, y que la reeducación o "reskilling" no podrá resolver, es el problema ético que trae aparejada la IA. La Inteligencia Artificial es una máquina perfecta de correlaciones estadísticas. La IA tiene la capacidad de predecir respuestas que funcionan con índices de exactitud cada vez mayores, pero no puede reconocer las relaciones causa-efecto. La IA no puede explicar por qué predice lo que predice, sólo puede indicarnos con qué grado de exactitud su respuesta es correcta. Al decir de Arthur C. Clarke: "Una cantidad suficiente de potencia tecnológica es imposible de diferenciar de la magia".

La Inteligencia Artificial no puede entender ni explicar sus resultados, son para ella meras correlaciones estadísticas. Con la IA podemos predecir eventos, pero no podemos comprenderlos. He aquí el gran desafío. Henry Kissinger recientemente hizo una distinción muy importante al asegurar que avanzar en el conocimiento no implica necesariamente hacerlo en el entendimiento.

"Knowledge" y "Understanding" nos invita a diferenciar dice Kissinger. Esa diferencia señala las posibilidades y desafíos que implica trabajar IA y humanos mancomunadamente. También está omnipresente el sesgo actual de creer que todo lo que venga de una IA es necesariamente correcto. El temor a lo desconocido e incontrolable, también. El valor de la duda y de la búsqueda de evidencias concretas y reales se vuelve más vital que nunca.

Además de los sesgos y prejuicios que podríamos "contagiarle" a la IA, y que seguramente podamos evitar en menor o mayor manera, la problemática más aguda es la incapacidad de la IA de comprender las consecuencias de sus "actos" o recomendaciones.

Hannah Arendt, cuando hablaba de la banalidad del mal, explicaba que muchas veces el mal deriva de la incapacidad de pensar y reflexionar sobre las acciones y sus consecuencias. Pensar no es lo mismo que tener conocimiento y tener conocimiento no equivale a sabiduría.

-¿Cuál te parece que es el gran riesgo de la Inteligencia Artificial?

El psiquiatra Viktor Frankl, el creador de la logoterapia y sobreviviente del Holocausto, nos regaló uno de los libros más imprescindibles de todos los tiempos y que se resignifica – aún más – con la problemática que plantea la IA: "El Hombre en busca de Sentido".

Frankl afirma y nos recuerda que: "Al hombre se le puede arrebatar todo salvo una cosa, la última de las libertades humanas: la elección de la actitud personal ante un conjunto de circunstancias, para decidir su propio camino". El gran riesgo al que nos expone la IA es el dejar de pensar, es el dejar de elegir, es el dejar de medir las consecuencias, es el dejar de intentar entender los por qué, es el dejar de buscar y sostener un propósito. El sentido de la vida para Viktor Frankl está en hallar un propósito, en asumir una responsabilidad para con nosotros mismos y para el propio ser humano.

Yahoo Finanzas

Yahoo Finanzas